To tylko jedna z 9 stron tej notatki. Zaloguj się aby zobaczyć ten dokument.

Zobacz

całą notatkę

Opisowe miary siły korelacji dwóch zmiennych Siłę współzależności dwóch zmiennych można wyrazić liczbowo za pomocą wielu mierników . Ich wybór jest uzależniony m.in. od rodzaju cech , między którymi badana jest zależność (mierzalne, niemierzalne, mieszane); liczby obserwacji (tablica korelacyjna, szeregi korelacyjne), kształtu zależności (regresja, prostoliniowa, krzywoliniowa).

Zakładając, że współzależność badanych zmiennych losowych X i Y jest statystycznie istotna, możemy wyróżnić cztery rodzaje podstawowych miar sił korelacji tych zmiennych:

współczynnik zbieżności Czuprowa;

wskaźniki (stosunki) korelacyjne Pearsona;

współczynnik korelacji liniowej Pearsona;

współczynnik rang (korelacji kolejnościowej) Spearmana.

Współczynnik zbieżności Czuprowa

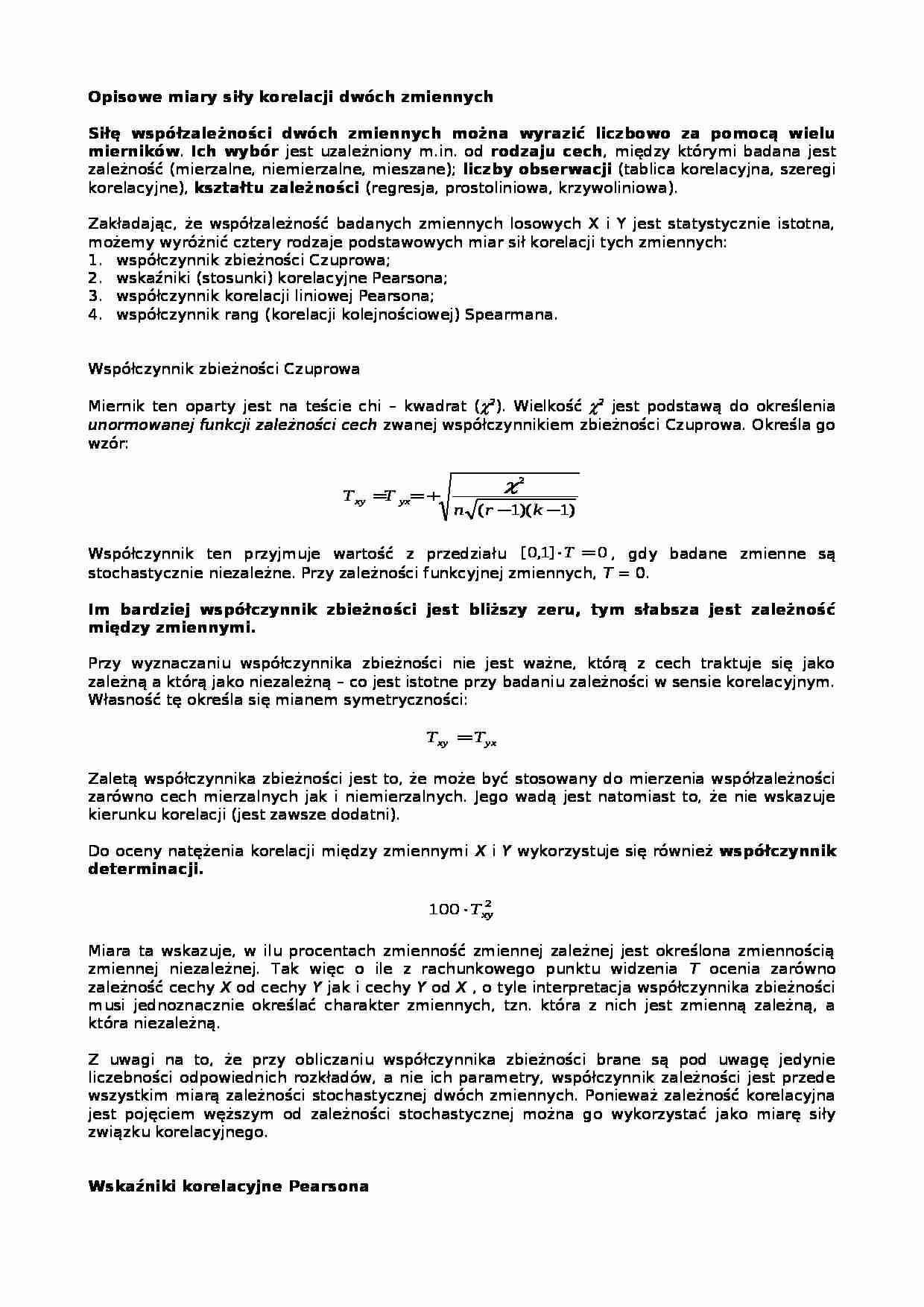

Miernik ten oparty jest na teście chi - kwadrat ( χ 2 ). Wielkość χ 2 jest podstawą do określenia unormowanej funkcji zależności cech zwanej współczynnikiem zbieżności Czuprowa. Określa go wzór:

Współczynnik ten przyjmuje wartość z przedziału , gdy badane zmienne są stochastycznie niezależne. Przy zależności funkcyjnej zmiennych, T = 0. Im bardziej współczynnik zbieżności jest bliższy zeru, tym słabsza jest zależność między zmiennymi. Przy wyznaczaniu współczynnika zbieżności nie jest ważne, którą z cech traktuje się jako zależną a którą jako niezależną - co jest istotne przy badaniu zależności w sensie korelacyjnym. Własność tę określa się mianem symetryczności:

Zaletą współczynnika zbieżności jest to, że może być stosowany do mierzenia współzależności zarówno cech mierzalnych jak i niemierzalnych. Jego wadą jest natomiast to, że nie wskazuje kierunku korelacji (jest zawsze dodatni).

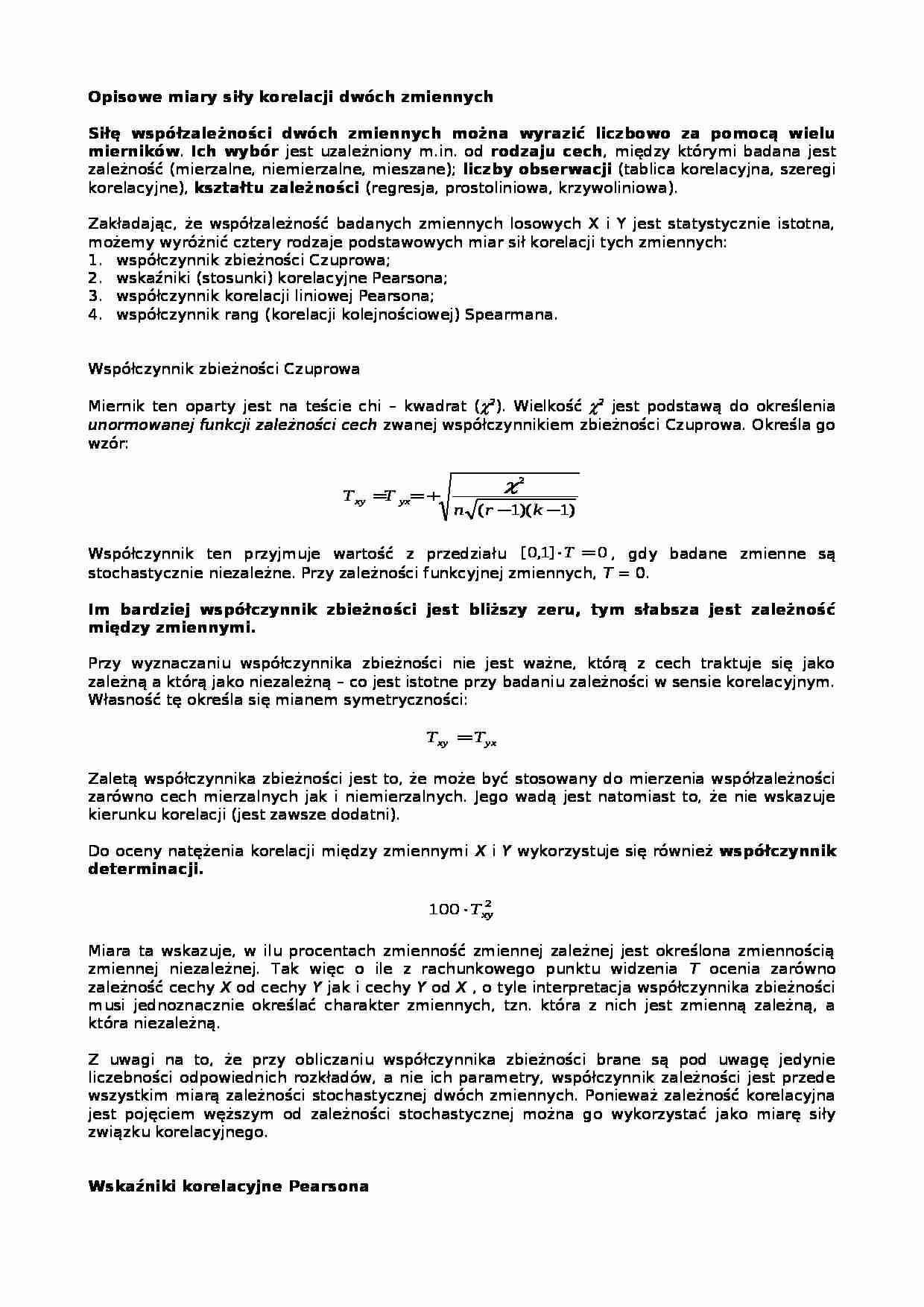

Do oceny natężenia korelacji między zmiennymi X i Y wykorzystuje się również współczynnik determinacji. Miara ta wskazuje, w ilu procentach zmienność zmiennej zależnej jest określona zmiennością zmiennej niezależnej. Tak więc o ile z rachunkowego punktu widzenia T ocenia zarówno zależność cechy X od cechy Y jak i cechy Y od X , o tyle interpretacja współczynnika zbieżności musi jednoznacznie określać charakter zmiennych, tzn. która z nich jest zmienną zależną, a która niezależną.

Z uwagi na to, że przy obliczaniu współczynnika zbieżności brane są pod uwagę jedynie liczebności odpowiednich rozkładów, a nie ich parametry, współczynnik zależności jest przede wszystkim miarą zależności stochastycznej dwóch zmiennych. Ponieważ zależność korelacyjna jest pojęciem węższym od zależności stochastycznej można go wykorzystać jako miarę siły związku korelacyjnego.

(…)

… nie jest dwukrotnie większa od rxy = 0,45.

Kwadrat współczynnika korelacji nazywamy współczynnikiem determinacji . Informuje on o tym, jaka część zmian zmiennej objaśniającej (skutek) jest wyjaśniona przez zmiany zmiennej objaśniającej (przyczyna). Przykład 2

W pewnym Urzędzie Stanu Cywilnego pewnego dnia przeprowadzono badanie nowo zawartych małżeństw wg wieku żony i męża. Wyniki badania losowo pobranych par…

… numerów. Mówi się wówczas o występowaniu węzłów.

Jednakowe rangi wartości badanych zmiennych (lub na ogół jednakowe) świadczą o istnieniu dodatniej korelacji między zmiennymi. Natomiast przeciwstawna numeracja sugeruje istnienie korelacji ujemnej.

Współczynnik rang przyjmuje wartości z przedziału -1 < rs < +1, a jego interpretacja jest identyczna jak współczynnika korelacji Pearsona.

Przykład 4…

… liniowej Pearsona jest wyznaczany poprzez standaryzację kowariancji. Kowariancja jest średnią arytmetyczną iloczynu odchyleń wartości zmiennych X i Y od ich średnich arytmetycznych:

Kowariancja przekazuje następujące informacje o związku korelacyjnym:

cov(x,y) = 0 - brak zależności korelacyjnej;

cov(x,y) < 0 - ujemna zależność korelacyjna;

cov(x,y) > 0 - dodatnia zależność korelacyjna.

Kowariancja przyjmuje wartości liczbowe z przedziału: [-s(x)s(y), +s s(x)s(y)], gdzie s(x) i s(y) są odchyleniami standardowymi odpowiednich zmiennych.

Jeżeli cov(x,y) = -s(x)s(y), to między zmiennymi istnieje ujemny związek funkcyjny. Przy dodatnim związku funkcyjnym cov(x,y) = +s(x)s(y).

Kowariancja charakteryzuje współzmienność badanych zmiennych, ale jej wartość zależy od rzędu wielkości, w jakich wyrażone…

... zobacz całą notatkę

Komentarze użytkowników (0)